Pendahuluan

Dalam diskusi tentang masa depan komputasi modern, tiga istilah sering muncul berdampingan namun kerap tertukar maknanya: Cloud Native, AI-Native Engineering, dan AI-Native Architecture. Ketiganya sering digunakan secara bergantian seolah-olah merujuk pada hal yang sama, padahal mereka beroperasi pada lapisan yang berbeda dan menjawab pertanyaan yang berbeda pula.

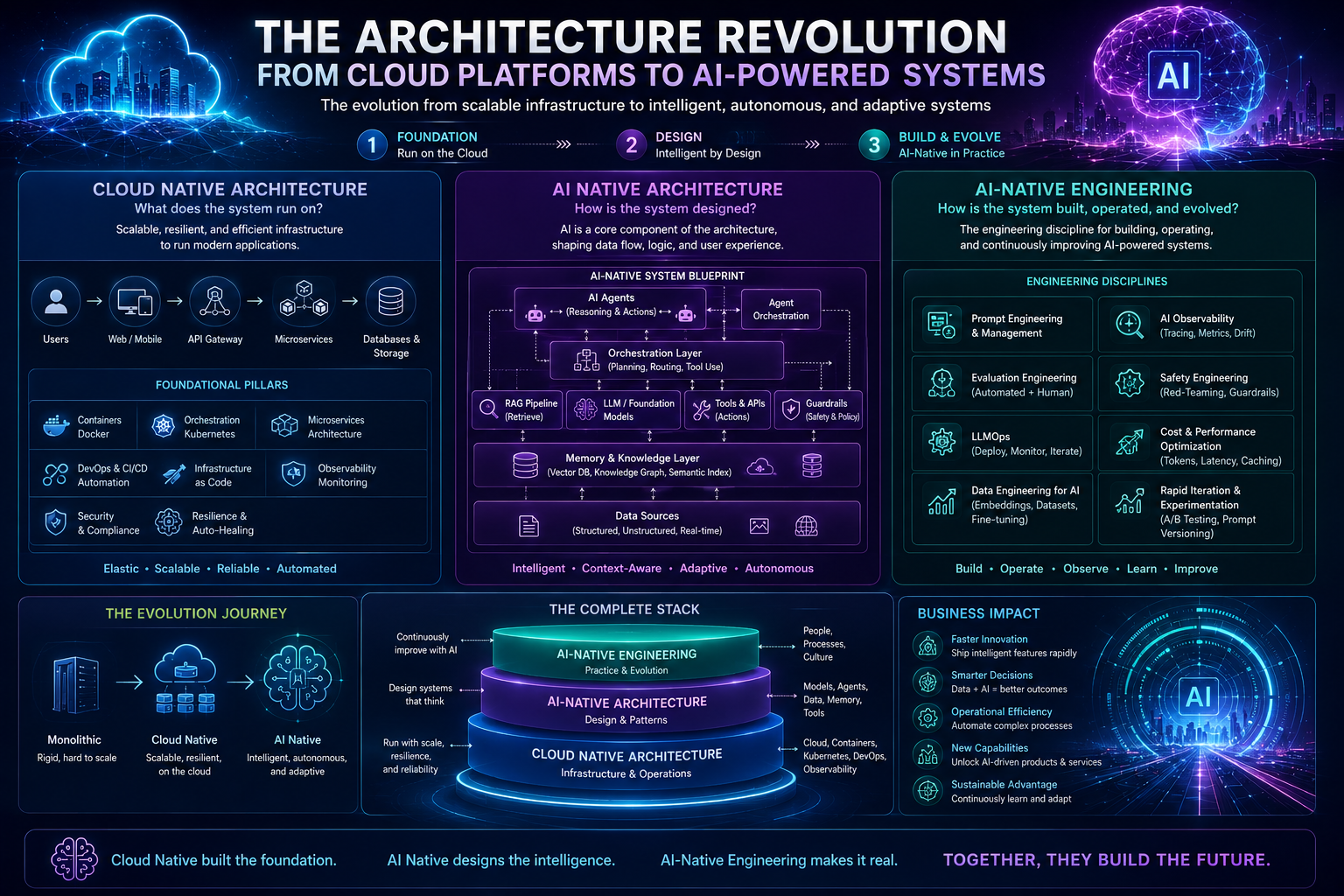

Cloud Native menjawab pertanyaan "di atas apa sistem ini berjalan?". AI-Native Architecture menjawab "bagaimana sistem ini dirancang?". AI-Native Engineering menjawab "bagaimana sistem ini dibangun, dioperasikan, dan dievolusi?".

Ketiganya bukan konsep yang bersaing, melainkan saling melengkapi dalam tumpukan yang koheren. Memahami hubungan di antara ketiganya menjadi krusial bagi siapa pun yang merancang sistem modern di era model generatif besar. Artikel ini akan membahas masing-masing konsep, hubungan di antara ketiganya, dan bagaimana mereka berkonvergensi untuk membentuk paradigma baru pengembangan perangkat lunak.

Tiga Lapisan, Tiga Pertanyaan Berbeda

Untuk memahami hubungan ketiganya, kita perlu melihat masing-masing sebagai jawaban atas pertanyaan yang berbeda dalam siklus hidup sistem.

Cloud Native: Lapisan Fondasi

Cloud Native adalah paradigma infrastruktur dan operasi yang lahir untuk memanfaatkan elastisitas, keandalan, dan skalabilitas cloud computing. Cloud Native Computing Foundation (CNCF) mendefinisikannya sebagai pendekatan yang memanfaatkan kontainer, microservices, infrastructure as code, declarative APIs, dan immutable infrastructure.

Karakteristik utamanya:

Containerisasi sebagai unit deployment yang portabel

Orkestrasi melalui Kubernetes atau platform serupa

Microservices yang dipisahkan secara longgar

DevOps dan CI/CD untuk siklus rilis cepat

Observability untuk pemantauan terdistribusi

Resilience melalui redundansi dan self-healing

Cloud Native adalah jawaban atas tantangan skala dan kecepatan rilis perangkat lunak modern. Ia memberi kita fondasi infrastruktur yang elastis, berulang, dan dapat dikelola secara deklaratif.

AI-Native Architecture: Lapisan Desain

AI-Native Architecture adalah pola perancangan sistem di mana model AI bukan sekadar fitur tambahan, melainkan komponen sentral yang membentuk seluruh aliran data, logika bisnis, dan pengalaman pengguna. Ia menjawab pertanyaan tentang bentuk sistem.

Sebuah arsitektur AI-native umumnya memiliki:

Model-as-a-component: model AI sebagai komponen first-class, bukan blackbox eksternal

Retrieval-Augmented Generation (RAG): pemisahan antara pengetahuan statis (model) dan pengetahuan dinamis (vector database, knowledge graph)

Agentic patterns: agen yang dapat memilih alat, mengambil tindakan, dan merencanakan langkah multi-tahap

Semantic data layer: representasi data yang dapat dipahami model (embeddings, ontologi)

Probabilistic flow control: logika bisnis yang menerima ketidakpastian sebagai input alami

Memory systems: lapisan memori jangka pendek dan jangka panjang untuk menjaga konteks pengguna

Guardrails dan validation: lapisan keamanan dan kualitas yang menyaring input dan output model

Arsitektur AI-native bukan sekadar "menambahkan API ChatGPT ke aplikasi yang sudah ada." Ia adalah cara berpikir baru tentang bagaimana data, model, dan pengguna berinteraksi.

AI-Native Engineering: Lapisan Praktik

Jika arsitektur adalah cetak biru, engineering adalah praktik membangun, mengoperasikan, dan mengevolusi cetak biru itu menjadi sistem nyata. AI-Native Engineering adalah disiplin praktik dan budaya rekayasa untuk sistem yang berpusat pada AI.

Komponennya meliputi:

Prompt engineering dan management: prompt sebagai artefak versi yang harus diuji dan di-deploy

Evaluation engineering: metode evaluasi otomatis dan manusiawi untuk output probabilistik

LLMOps: pipeline untuk deployment, monitoring, dan iterasi model bahasa

Data engineering untuk AI: pipeline embedding, dataset evaluasi, fine-tuning data

Cost dan performance engineering: optimasi biaya per token, latensi TTFT/TPOT, caching strategis

Safety engineering: red-teaming, evaluasi bias, audit halusinasi

Observability untuk AI: tracing prompt, metrik kualitas, drift detection

Iterasi cepat: A/B testing untuk perilaku model, eksperimen perubahan prompt

AI-Native Engineering adalah evolusi dari DevOps dan MLOps, tetapi dengan tantangan unik: outputnya tidak deterministik, perilakunya bisa berubah ketika model di-update meskipun kode tidak diubah, dan kualitasnya sulit didefinisikan dalam unit test tradisional.

Hubungan Hierarkis: Fondasi, Cetak Biru, dan Konstruksi

Cara paling intuitif untuk memahami hubungan ketiganya adalah melalui analogi konstruksi bangunan.

┌─────────────────────────────────────────────────────┐

│ AI-Native Engineering │

│ (Praktik membangun, mengoperasikan, mengevolusi) │

├─────────────────────────────────────────────────────┤

│ AI-Native Architecture │

│ (Desain dan pola sistem berpusat AI) │

├─────────────────────────────────────────────────────┤

│ Cloud Native │

│ (Fondasi infrastruktur, runtime, operasi) │

└─────────────────────────────────────────────────────┘Cloud Native adalah tanah dan fondasi: ia menyediakan landasan tempat segala sesuatu berdiri. Tanpa fondasi yang kokoh, sistem AI tidak dapat diskalakan, dipantau, atau di-deploy secara andal.

AI-Native Architecture adalah cetak biru bangunan: ia menentukan bentuk, ruang, dan aliran. Ia memutuskan di mana model akan berada, bagaimana data mengalir, bagaimana pengguna berinteraksi, dan bagaimana komponen-komponen saling terhubung.

AI-Native Engineering adalah proses konstruksi dan pemeliharaan: ia adalah disiplin yang mengubah cetak biru menjadi struktur nyata, kemudian merawat, memperbaiki, dan memperluasnya seiring waktu.

Ketiganya tidak dapat dipisahkan. Cetak biru AI-native yang brilian akan gagal jika dibangun di atas fondasi cloud-native yang lemah atau dengan praktik engineering yang buruk. Sebaliknya, praktik engineering terbaik tidak akan menyelamatkan arsitektur yang dirancang buruk.

Bagaimana Cloud Native Mendukung AI-Native

Cloud Native menyediakan kemampuan yang menjadi prasyarat bagi sistem AI modern:

Elastisitas perangkat keras heterogen. Kubernetes telah berevolusi dari sekadar penjadwal CPU menjadi platform yang mengelola GPU, TPU, dan akselerator khusus. Project seperti NVIDIA GPU Operator, Kueue, dan Volcano memperluas Kubernetes untuk beban kerja AI.

Deklaratif dan reproducible. Infrastructure as Code memungkinkan tim AI mendefinisikan environment training dan inference yang dapat direproduksi, sebuah kebutuhan kritis ketika hasil model bergantung pada konfigurasi yang sangat detail.

Observability terdistribusi. Sistem AI modern adalah jaringan komponen: vector store, retrieval service, model serving, guardrails, dan caching layer. Tooling cloud-native seperti OpenTelemetry, Prometheus, dan Jaeger dapat diperluas untuk melacak alur ini.

CI/CD untuk model dan prompt. Pipeline cloud-native menjadi tulang punggung untuk deployment model dan prompt secara bertahap, lengkap dengan canary release dan rollback otomatis.

Tanpa cloud-native, AI-native akan menjadi rangkaian skrip artisanal yang sulit diskalakan ke produksi.

Bagaimana AI-Native Architecture Mengandalkan Engineering

Arsitektur AI-native memperkenalkan pola-pola baru yang membutuhkan praktik engineering yang sesuai. Beberapa contoh konkret:

RAG membutuhkan data engineering yang serius. Kualitas retrieval menentukan kualitas generasi. Ini berarti tim engineering harus mengelola pipeline embedding, evaluasi recall dan precision, strategi chunking, dan refresh data secara berkala.

Agen AI membutuhkan evaluation engineering. Sebuah agen yang dapat memanggil alat dan mengambil tindakan multi-langkah memiliki ruang state yang sangat luas. Engineering harus mendefinisikan metrik keberhasilan, membuat dataset benchmark, dan menjalankan evaluasi otomatis pada setiap perubahan.

Probabilistic flow control membutuhkan observability baru. Ketika satu langkah dalam alur dapat menghasilkan output yang berbeda untuk input yang sama, debugging tradisional tidak cukup. Tim engineering harus menerapkan tracing semantik yang menangkap input, output, dan reasoning model.

Guardrails membutuhkan safety engineering berkelanjutan. Filter konten, deteksi prompt injection, dan validasi output bukan komponen yang dipasang sekali. Mereka adalah sistem hidup yang membutuhkan red-teaming berkala dan pembaruan terhadap ancaman baru.

Pendek kata, arsitektur AI-native memunculkan kelas masalah engineering baru yang tidak ada di dunia cloud-native murni.

Siklus Kolaboratif Ketiganya

Dalam praktik nyata, ketiga lapisan ini tidak statis; mereka membentuk siklus umpan balik yang berkelanjutan.

Dari Engineering ke Architecture. Insight dari produksi sering memaksa perubahan arsitektur. Misalnya, tim engineering mungkin menemukan bahwa biaya inference terlalu tinggi karena prompt terlalu panjang. Solusinya bukan optimasi tingkat rendah, tetapi memperkenalkan cache semantik atau memisahkan jalur prefill-decode, sebuah keputusan arsitektural.

Dari Architecture ke Cloud Native. Pola arsitektur baru membentuk evolusi platform cloud-native. Ketika RAG menjadi standar, vector database menjadi kebutuhan first-class. Ketika agen menjadi umum, runtime untuk eksekusi alat yang aman menjadi infrastruktur kritis. Cloud-native menyerap pola-pola ini dan mengangkatnya menjadi layanan platform.

Dari Cloud Native ke Engineering. Kapabilitas baru pada lapisan platform memungkinkan praktik engineering baru. Misalnya, dukungan native Kubernetes untuk multi-instance GPU memungkinkan tim menjalankan A/B testing model dengan biaya lebih rendah, yang pada gilirannya mengubah cara tim mengevaluasi perubahan.

Dengan kata lain, ketiga lapisan saling membentuk satu sama lain dalam siklus evolusi yang terus-menerus.

Tantangan Integrasi

Mengintegrasikan ketiga lapisan secara mulus bukan hal yang sepele. Beberapa tantangan utama:

Boundary blur. Garis antara "infrastruktur" dan "aplikasi" menjadi kabur. Apakah vector database adalah komponen platform (cloud-native) atau komponen arsitektur aplikasi (AI-native)? Jawabannya bergantung pada konteks organisasi, dan keputusan ini berdampak pada siapa yang memiliki dan mengoperasikan komponen tersebut.

Skill gap. Tim cloud-native yang ahli dalam Kubernetes belum tentu memahami nuansa LLM serving. Tim ML yang ahli dalam training model belum tentu memahami best practice deployment terdistribusi. AI-native engineering menuntut perpaduan keahlian yang langka.

Tooling fragmentation. Ekosistem AI-native bergerak sangat cepat dengan banyak tool yang tumpang tindih. Memilih stack yang tepat dan menjaga konsistensi antar tim adalah tantangan terus-menerus.

Cost visibility. Biaya GPU jauh lebih tinggi dari CPU, dan biaya per token bisa sangat bervariasi tergantung pola penggunaan. Tim membutuhkan visibilitas biaya yang lebih granular daripada yang biasa disediakan platform cloud-native.

Probabilistic quality. Tidak ada konsep "100% test coverage" yang setara untuk sistem AI. Tim harus menerima bahwa kualitas adalah distribusi, bukan biner, dan membangun proses untuk mengelola distribusi itu.

Pola Konvergensi: Menuju AI-Native Platform

Tren yang muncul saat ini adalah konvergensi ketiga lapisan menjadi apa yang sering disebut sebagai AI-Native Platform atau AI Engineering Platform. Karakteristiknya:

Kubernetes yang sadar AI: orkestrator yang memahami GPU, model, dan beban kerja inference secara native

Model serving sebagai layanan platform: bukan tugas tim aplikasi, tetapi disediakan oleh platform

Vector store dan retrieval sebagai layanan terkelola: setara dengan database tradisional

Evaluation framework terintegrasi: built-in pada CI/CD pipeline

Observability untuk LLM: tracing prompt, metrik kualitas, dan drift detection sebagai standar

Cost governance: visibilitas biaya per request, per pengguna, per fitur

Platform seperti ini memungkinkan tim aplikasi fokus pada business logic dan user experience, sementara kompleksitas tingkat rendah dari serving model, manajemen GPU, dan observability terdistribusi diabstraksikan oleh platform.

Ini adalah evolusi alami yang sama dengan apa yang terjadi pada cloud-native dua dekade lalu: dari ops manual, ke virtualisasi, ke containerization, ke platform orkestrasi penuh. AI-native akan melalui jalur yang sama, hanya saja dengan kecepatan yang lebih tinggi.

Implikasi Praktis bagi Organisasi

Untuk organisasi yang ingin mengadopsi paradigma ini, beberapa rekomendasi praktis:

Jangan lewati cloud-native. Tanpa fondasi cloud-native yang matang, upaya AI-native akan terhambat oleh masalah operasional dasar. Investasi pada Kubernetes, observability, dan CI/CD adalah prasyarat.

Pisahkan keputusan arsitektur dari keputusan tooling. Pilih pola arsitektur (RAG, agentic, hybrid) berdasarkan kebutuhan domain, bukan tool yang sedang tren. Tool akan berubah; pola arsitektur lebih tahan lama.

Bangun praktik evaluasi sejak awal. AI-native engineering tanpa evaluasi yang sistematis sama dengan terbang tanpa instrumen. Investasi pada dataset evaluasi dan automasi evaluasi sama pentingnya dengan investasi pada model itu sendiri.

Definisikan kepemilikan platform. Identifikasi tim yang bertanggung jawab atas lapisan platform AI-native, dan bedakan dari tim aplikasi. Tanpa pemisahan ini, setiap tim akan membangun ulang kapabilitas yang sama secara terpisah.

Investasi pada keterampilan lintas-disiplin. Insinyur AI-native masa depan akan membutuhkan pemahaman tentang sistem terdistribusi, machine learning, dan domain bisnis secara bersamaan. Pelatihan dan rotasi tim menjadi penting.

Kesimpulan

Cloud Native, AI-Native Architecture, dan AI-Native Engineering bukan konsep yang bersaing, melainkan tiga lapisan dari satu paradigma yang lebih besar untuk membangun sistem cerdas modern.

Cloud Native adalah fondasi: infrastruktur yang elastis dan terkelola yang menjadikan segala sesuatu di atasnya mungkin. AI-Native Architecture adalah cetak biru: pola desain yang menempatkan model AI sebagai inti sistem, bukan sekadar pelengkap. AI-Native Engineering adalah disiplin praktik: cara membangun, mengoperasikan, dan mengevolusi sistem itu di dunia nyata dengan menerima sifat probabilistiknya.

Organisasi yang berhasil di era ini bukan mereka yang menguasai salah satu lapisan saja, melainkan yang memahami bagaimana ketiganya saling membentuk dan berkolaborasi. Mereka memperlakukan cloud-native sebagai prasyarat yang matang, AI-native architecture sebagai keputusan strategis yang berhati-hati, dan AI-native engineering sebagai budaya yang terus berkembang.

Era model generatif besar tidak menggantikan cloud-native; ia membangun di atasnya. Namun untuk benar-benar memanfaatkan kapabilitas baru ini, kita perlu cara berpikir baru tentang arsitektur dan praktik baru tentang rekayasa. Ketiganya, bersama-sama, membentuk dasar bagi gelombang aplikasi cerdas berikutnya, yang akan mendefinisikan dekade mendatang dalam komputasi.