Pendahuluan

Selama dua tahun terakhir, dunia teknologi sibuk membicarakan transisi dari Cloud-Native ke AI-Native. Namun, sementara banyak organisasi baru memulai perjalanan adopsi AI-Native, lanskap teknologi sudah bergerak lebih jauh. Sejumlah paradigma baru muncul yang melampaui sekadar "menempatkan model AI sebagai komponen sentral."

Paradigma-paradigma ini bukan menggantikan AI-Native, melainkan memperluasnya: menambah lapisan baru, memperluas cakupan domain, atau mengubah unit dasar komputasi. Memahami arah evolusi ini penting bagi organisasi yang tidak ingin tertinggal saat investasi mereka dalam AI-Native baru saja matang.

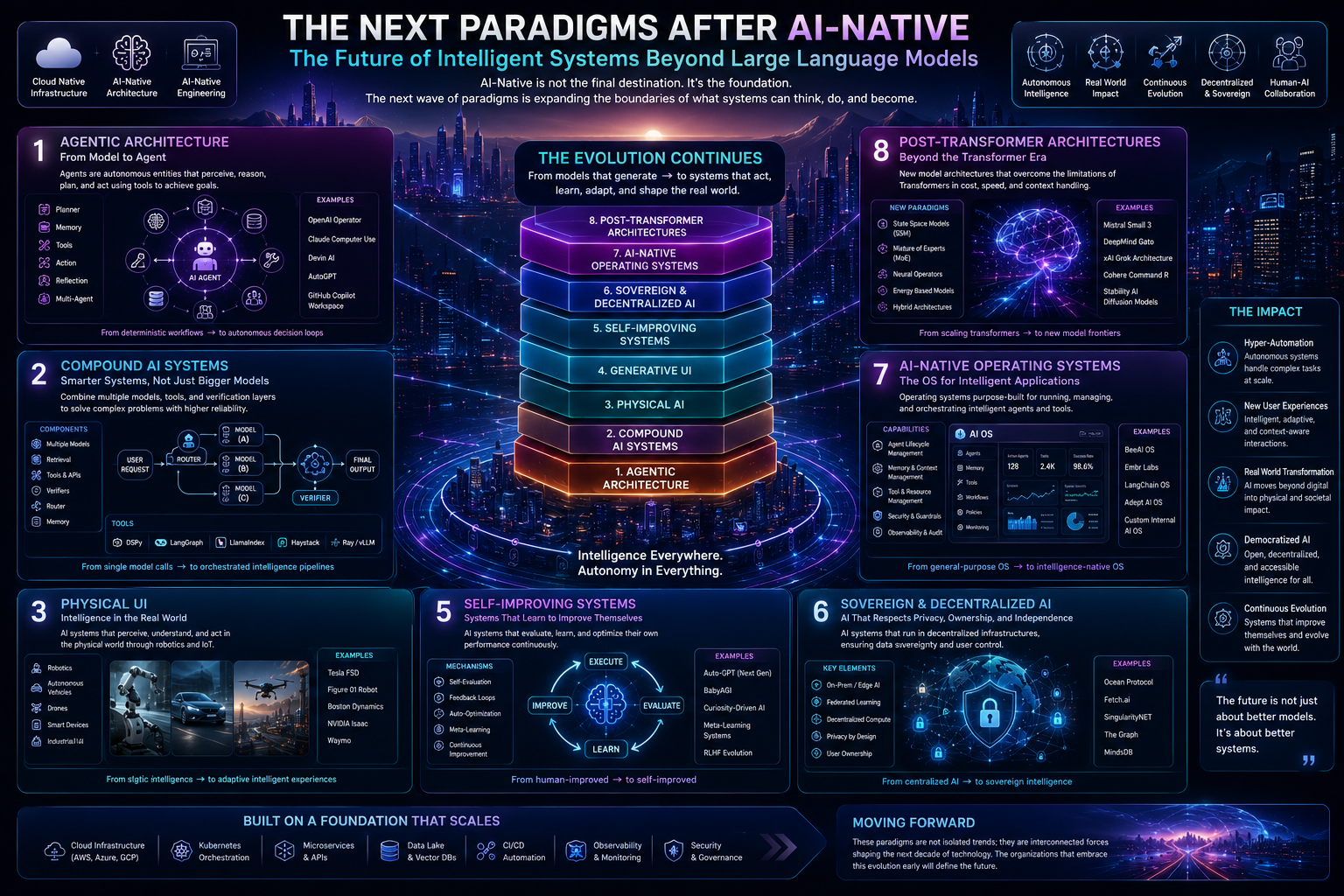

Artikel ini membahas delapan paradigma yang sedang membentuk era pasca-LLM: Agentic Architecture, Compound AI Systems, Physical AI, Generative UI, Self-Improving Systems, Sovereign & Decentralized AI, AI-Native Operating Systems, dan Post-Transformer Architectures. Untuk masing-masing, kita akan melihat definisi, motivasi, contoh konkret, status kematangan, dan implikasi arsitektural.

1. Agentic Architecture: Dari Model ke Agen

Pergeseran Paradigma

Jika AI-Native menempatkan model sebagai komponen sentral sistem, Agent-Native atau Agentic Architecture menempatkan agen otonom sebagai unit komputasi dasar. Perbedaannya bukan kosmetik. Sebuah model adalah fungsi: input prompt, output teks. Sebuah agen adalah entitas dengan tujuan, memori, akses ke alat, kemampuan merencanakan, dan kapasitas mengambil tindakan di dunia.

Agen tidak hanya merespons; ia memutuskan apa yang perlu dilakukan, mengeksekusi langkah, mengamati hasilnya, dan menyesuaikan rencana. Ini mengubah aplikasi dari "alur deterministik dengan panggilan AI" menjadi "loop otonom dengan AI sebagai pengambil keputusan."

Komponen Inti

Arsitektur agentic umumnya terdiri dari:

Planner: komponen yang memecah tujuan tingkat tinggi menjadi langkah-langkah konkret

Tool layer: kumpulan alat yang dapat dipanggil agen (API, database query, browser, code execution)

Memory system: memori jangka pendek (working memory) dan jangka panjang (episodic, semantic)

Executor / runtime: lingkungan aman untuk mengeksekusi tindakan agen

Reflection / self-correction: kemampuan agen mengevaluasi langkahnya sendiri dan mencoba ulang

Multi-agent coordination: mekanisme untuk agen-agen berkolaborasi atau berdebat

Standar yang Muncul

Pada 2025-2026, standar interoperabilitas agen mulai mengkristal:

Model Context Protocol (MCP) dari Anthropic — standar terbuka untuk menghubungkan model dengan alat dan sumber data

Agent2Agent (A2A) dari Google — protokol komunikasi antar-agen

OpenAI Agents SDK dan Microsoft Semantic Kernel — kerangka kerja komersial

Standar ini penting karena tanpa interoperabilitas, setiap agen hidup di silonya sendiri, mengulang masalah fragmentasi yang dulu ditangani protokol seperti HTTP atau gRPC.

Contoh Konkret

Claude Code, Cursor Composer, GitHub Copilot Workspace — coding agents

OpenAI Operator, Claude Computer Use — browser dan komputer use agents

Devin, Replit Agent — software engineering agents otonom

Manus AI, AutoGPT — general-purpose task agents

Implikasi Arsitektural

Loop sebagai unit, bukan request: latensi tidak lagi diukur per panggilan API, tetapi per task yang bisa berlangsung menit hingga jam

Eksekusi sandbox yang aman: agen yang dapat menjalankan kode atau memanipulasi file membutuhkan isolasi kuat

Audit trail dan reversibility: setiap tindakan agen perlu dapat dilacak dan, jika perlu, dibalikkan

Cost dan budget control: agen yang berjalan otonom dapat menghabiskan budget komputasi dengan cepat tanpa kontrol

2. Compound AI Systems: Sistem Lebih Cerdas, Bukan Model Lebih Besar

Tesis Utama

Istilah Compound AI Systems dipopulerkan oleh Berkeley AI Research (BAIR) pada 2024. Tesisnya: kemajuan AI di tingkat sistem akan datang bukan dari model tunggal yang semakin besar, melainkan dari orkestrasi banyak komponen yang bekerja sama.

Bukti pendukungnya kuat: sistem state-of-the-art di banyak benchmark (kompetisi pemrograman, riset, agen) bukan satu model raksasa, melainkan kombinasi model + retrieval + alat + validator + reasoning loop.

Komponen yang Sering Digabungkan

Multiple specialized models: model kuat untuk reasoning, model cepat untuk classification, model murah untuk drafting

Retrieval systems: vector search, knowledge graph, full-text search

External tools: kalkulator, code execution, web search, database query

Verifiers / validators: model yang memeriksa output model lain

Routers: komponen yang memilih model atau alur mana yang dipakai untuk input tertentu

Self-consistency mechanisms: menjalankan inference berkali-kali dan memilih konsensus

Tooling yang Mendukung

DSPy dari Stanford — kerangka deklaratif untuk membangun pipeline AI yang dapat dioptimasi otomatis

LangGraph — orkestrasi alur dengan state dan branching

LlamaIndex dan Haystack — pipeline retrieval-augmented yang kompleks

Ray dan vLLM — runtime untuk menjalankan banyak model bersamaan secara efisien

Mengapa Ini Penting

Compound AI mengubah ekonomi AI. Alih-alih membayar untuk model frontier paling mahal di setiap panggilan, sistem dapat merutekan tugas mudah ke model murah dan menyimpan model mahal untuk reasoning yang benar-benar membutuhkannya. Ini juga meningkatkan keandalan: bila satu model gagal atau berhalusinasi, validator atau model alternatif dapat menangkapnya.

Implikasi Arsitektural

Pipeline sebagai artefak first-class: bukan kode imperatif yang memanggil API, melainkan graf yang dapat dioptimasi

Model gateway dan router: lapisan baru di tumpukan yang memilih model dinamis

Evaluasi tingkat pipeline, bukan model: yang penting adalah kualitas output akhir, bukan akurasi komponen individu

3. Physical AI: Membawa Kecerdasan ke Dunia Fisik

Pergeseran Domain

Selama bertahun-tahun, AI didominasi oleh teks dan piksel di layar. Physical AI atau Embodied AI memperluas domain ini ke dunia fisik: robot, kendaraan otonom, drone, perangkat IoT, dan sistem cyber-physical.

Tantangan kunci: dunia fisik tidak deterministik, latensi sensor-aktuator harus rendah, kesalahan punya konsekuensi fisik (bukan sekadar respons buruk), dan data pelatihan langka serta mahal untuk dikumpulkan.

Konsep World Models

Salah satu inovasi terpenting adalah world models — model yang mempelajari simulasi internal tentang bagaimana dunia bekerja. Alih-alih hanya merespons input, world model dapat memprediksi konsekuensi tindakan, memungkinkan perencanaan dan pembelajaran melalui simulasi.

NVIDIA Cosmos, Google DeepMind Genie, dan Meta V-JEPA adalah contoh upaya ke arah ini. Genie 3, misalnya, dapat menghasilkan dunia interaktif yang konsisten secara fisik dari prompt teks.

Robotics Foundation Models

Sebagaimana LLM menjadi fondasi untuk teks, Robotics Foundation Models menjadi fondasi untuk kontrol robot:

NVIDIA GR00T untuk robot humanoid

Figure Helix untuk Figure 02

RT-2 dan RT-X dari Google DeepMind

Tesla Optimus dengan stack neural network end-to-end

Pendekatannya mirip: latih satu model besar pada banyak demonstrasi (manusia, simulasi, robot), kemudian fine-tune untuk task spesifik.

Implikasi Arsitektural

Latensi real-time: kontrol robot membutuhkan inference puluhan hingga ratusan Hz, jauh dari karakteristik LLM cloud

Edge deployment: model harus berjalan di robot itu sendiri atau di edge dekat

Simulation-to-real pipeline: training di simulasi (NVIDIA Isaac, MuJoCo) lalu transfer ke fisik

Sensor fusion: integrasi visi, LIDAR, force feedback, audio dalam satu representasi

Safety constraints: lapisan keamanan yang memvalidasi tindakan sebelum dieksekusi pada aktuator

4. Generative UI: Antarmuka yang Dihasilkan, Bukan Dirancang

Konsep

Antarmuka tradisional adalah statis: designer merancang screen, developer mengimplementasikannya, pengguna menavigasinya. Generative UI membalikkan model ini: antarmuka dihasilkan secara dinamis oleh AI berdasarkan niat pengguna, konteks, dan data yang relevan saat itu juga.

Bayangkan pengguna mengetik "saya ingin merencanakan liburan ke Bali untuk keluarga 4 orang awal Juli" — dan alih-alih membuka aplikasi travel dengan ratusan filter, AI menghasilkan UI khusus untuk task itu: peta interaktif, slider tanggal, kartu rekomendasi yang dapat di-drag, semua disesuaikan dengan konteks.

Contoh yang Sedang Berjalan

Vercel v0 — generasi komponen React dari prompt

Claude Artifacts — UI interaktif yang dihasilkan dalam percakapan

OpenAI Canvas — kolaborasi UI yang adaptif

Tambo, Thesys — kerangka kerja generative UI komersial

Apple Intelligence dan Android with Gemini — UI yang menyesuaikan dengan konteks pengguna

Mengapa Ini Penting

Aplikasi tradisional dirancang untuk rata-rata pengguna, sehingga setiap pengguna individu mengalami trade-off. Generative UI memungkinkan personalisasi mendalam pada level antarmuka: bukan hanya konten yang dipersonalisasi, tetapi struktur, layout, dan interaksi itu sendiri.

Tantangan Terbuka

Konsistensi vs adaptivitas: pengguna butuh pola yang dapat dipelajari, tapi UI generatif berubah-ubah

Aksesibilitas: UI yang dihasilkan AI harus tetap memenuhi standar a11y

Brand identity: bagaimana mempertahankan identitas merek ketika UI dihasilkan dinamis

Performa: generasi UI tidak boleh menambah latensi yang terasa

Trust dan kontrol: pengguna perlu mengerti dan dapat memodifikasi apa yang AI hasilkan

5. Self-Improving Systems: AI yang Membangun AI

Visi

Salah satu tujuan jangka panjang AI adalah sistem yang dapat memperbaiki dirinya sendiri: menulis kode, menjalankan eksperimen, mengevaluasi hasil, dan memperbarui versinya tanpa intervensi manusia setiap iterasi.

Penelitian dan Eksperimen

AlphaEvolve dari Google DeepMind — agen yang menemukan algoritma matematika dan optimasi baru

Sakana AI Scientist — sistem yang melakukan penelitian ML dari ide hingga paper otonom

AutoML generasi baru yang menggunakan LLM sebagai meta-optimizer

Self-play di reasoning models — model yang melatih dirinya sendiri melalui generasi sintetis dan verifikasi

Tingkat Kemandirian

Tidak semua "self-improving" sama. Spektrumnya:

Auto-tuning: sistem mengoptimasi hyperparameter atau prompt sendiri

Auto-architecting: sistem mengeksplorasi arsitektur model atau pipeline

Auto-research: sistem merumuskan hipotesis dan menjalankan eksperimen

Recursive self-improvement: sistem secara fundamental memperbaiki kapasitas dirinya

Saat ini, level 1-2 sudah praktis; level 3 masih eksperimental; level 4 masih spekulatif dan membawa pertanyaan keamanan AI yang serius.

Implikasi Arsitektural

Eksperimen sebagai infrastruktur first-class: training, evaluasi, dan deployment otomatis dalam loop

Versioning yang ketat: model yang melahirkan model membutuhkan tracking lineage yang sangat detail

Guardrails dan kill switches: kemampuan menghentikan loop self-improvement bila keluar jalur

Resource budget management: sistem self-improving bisa konsumsi compute eksponensial

6. Sovereign & Decentralized AI: Topologi Baru Infrastruktur

Reaksi terhadap Sentralisasi

Pasar AI saat ini didominasi oleh segelintir hyperscaler. Ini menciptakan kekhawatiran geopolitik, ketergantungan, dan kontrol data. Dua tren melawan tren ini muncul:

Sovereign AI: negara atau perusahaan menjalankan model fondasi sendiri di on-prem atau private cloud, dengan data yang tidak meninggalkan yurisdiksi. India, Uni Emirat Arab, Prancis (Mistral), dan Jepang (Sakana) adalah contoh kebijakan AI berdaulat.

Decentralized AI: training dan inference yang didistribusikan melalui jaringan peer-to-peer, sering dikombinasikan dengan ekonomi token. Bittensor, Gensyn, Akash Network, dan Together AI adalah pemain utama.

Komponen Teknologi Pendukung

Federated learning: training tanpa memindahkan data ke pusat

Confidential computing: enkripsi end-to-end untuk inference, bahkan dari pemilik infrastruktur

Model splitting & secure multi-party computation: model dipecah sehingga tidak ada pihak yang melihat keseluruhan

Open-weight models: Llama, Mistral, Qwen, DeepSeek menjadi fondasi yang dapat di-self-host

Edge AI accelerators: NPU di laptop dan ponsel memungkinkan inference lokal

Implikasi Arsitektural

Multi-region, multi-jurisdiction deployment menjadi default

Hybrid inference: sensitive query lokal, query umum cloud

Cryptographic trust sebagai gantinya trust pada cloud provider

Cost model yang berbeda: capex untuk hardware sendiri vs opex untuk cloud

7. AI-Native Operating Systems

Konsep

Sistem operasi tradisional dirancang sebelum AI: kernel mengelola proses, file system, jaringan; aplikasi adalah binary diskret yang diluncurkan pengguna. AI-Native OS mengusulkan rancangan ulang fundamental di mana AI bukan aplikasi melainkan primitif inti sistem operasi.

Andrej Karpathy dalam berbagai talk mengusulkan visi "LLM as kernel": LLM sebagai komponen yang mengoordinasikan seluruh sistem, dengan aplikasi tradisional menjadi alat yang dipanggil model.

Manifestasi Awal

Apple Intelligence dengan App Intents — aplikasi mengekspos kapabilitas yang dapat dipanggil oleh AI sistem

Microsoft Copilot+ PC dengan Recall dan integrasi OS-level

Android dengan Gemini Nano — model on-device yang terintegrasi

Rabbit R1, Humane AI Pin (meskipun secara komersial gagal) — eksperimen perangkat yang AI-native dari bawah ke atas

Komponen Konseptual

Memory OS: lapisan memori persisten yang mencatat semua interaksi pengguna untuk kontekstualisasi AI

Intent layer: pengguna mengekspresikan niat tingkat tinggi, OS menerjemahkannya ke aksi

Tool/skill registry: aplikasi sebagai kumpulan kapabilitas yang dapat dikomposisikan

Privacy-preserving context: konteks pengguna yang kaya tanpa mengirim semuanya ke cloud

Agentic shell: shell baru yang adalah agen, bukan command line

Tantangan

Backward compatibility dengan aplikasi tradisional

Latency budget untuk membuat OS tetap responsif

Privacy model yang lebih kompleks dari sandbox tradisional

Standar lintas platform untuk menghindari fragmentasi

8. Post-Transformer Architectures: Tantangan terhadap Status Quo Model

Mengapa Bukan Hanya Transformer?

Transformer mendominasi sejak 2017, tapi memiliki keterbatasan fundamental: kompleksitas perhatian kuadratik terhadap panjang konteks (O(n²)), dan KV-cache yang tumbuh linear. Ini batas keras untuk konteks panjang dan inference efisien.

Kandidat Pengganti / Pendamping

State Space Models (SSM) seperti Mamba dan Mamba-2: kompleksitas linear, throughput tinggi, konteks panjang

RWKV: hybrid antara RNN dan Transformer

Hyena, Striped Hyena: konvolusi long-range sebagai alternatif attention

Liquid Neural Networks: arsitektur dari MIT yang lebih kompak dan adaptif

Diffusion Language Models: generasi paralel, bukan auto-regressive token-by-token

xLSTM: revisi LSTM untuk era modern

Implikasi Bila Berhasil

KV-cache obsolete: jika SSM menggantikan attention, banyak teknik optimasi serving saat ini perlu dirancang ulang

Konteks tak terbatas praktis: dokumen jutaan token menjadi normal

Hardware ulang: akselerator yang dioptimasi Transformer (seperti TPU v5) mungkin tidak optimal untuk arsitektur baru

Model lebih kecil, kemampuan setara: efisiensi bisa berarti AI canggih di edge

Status Saat Ini

Pada 2026, model hybrid (Transformer + SSM) seperti Jamba dan Zamba mulai bersaing dengan Transformer murni di beberapa benchmark. Namun, ekosistem (tooling, optimasi) masih sangat berpusat Transformer. Transisi penuh, jika terjadi, akan butuh waktu bertahun-tahun.

Bagaimana Paradigma Ini Saling Berkaitan

Delapan paradigma di atas tidak terpisah; mereka membentuk lanskap yang saling berkait:

Agentic dibangun di atas Compound AI Systems — agen seringkali adalah pipeline kompleks dengan banyak model

Physical AI mengadopsi pola Agentic untuk perencanaan dan kontrol

Generative UI sering dijalankan oleh agen yang memahami niat pengguna

Self-improving systems menggunakan compound AI untuk eksplorasi otonom

Sovereign AI dan AI-Native OS sama-sama mendorong inferensi ke edge

Post-Transformer memungkinkan AI-Native OS dengan konteks panjang berjalan lokal

Lapisan tumpukan yang lebih lengkap pada 2026 terlihat seperti ini:

┌─────────────────────────────────────────────────────────┐

│ Self-Improving / Recursive Systems (spekulatif)│

├─────────────────────────────────────────────────────────┤

│ Agentic / Agent-Native Computing (momentum kuat) │

├─────────────────────────────────────────────────────────┤

│ Compound AI Systems (best practice) │

├─────────────────────────────────────────────────────────┤

│ AI-Native Architecture & Engineering (matang) │

├─────────────────────────────────────────────────────────┤

│ Cloud Native (fondasi) │

└─────────────────────────────────────────────────────────┘

Cabang horizontal yang berinteraksi dengan tumpukan:

• Physical / Embodied AI (domain fisik)

• Generative UI (lapisan presentasi)

• Sovereign / Decentralized AI (topologi infra)

• AI-Native Operating Systems (lapisan OS)

• Post-Transformer Architectures (lapisan model)Implikasi Praktis bagi Organisasi

Bagi organisasi yang sudah dalam perjalanan AI-Native, beberapa rekomendasi untuk menyiapkan paradigma berikutnya:

1. Bangun fondasi agentic sekarang. Bahkan jika Anda belum mengadopsi penuh agen otonom, mulai pelajari MCP, runtime sandbox, dan pola tool use. Ini akan menjadi keterampilan dasar dalam 1-2 tahun.

2. Adopsi pola compound, bukan model monolitik. Hindari mendesain sistem yang hanya bergantung pada satu API model. Bangun lapisan abstraksi yang memungkinkan routing, fallback, dan komposisi multi-model.

3. Eksplorasi generative UI di area sempit. Mulailah dari area dengan dampak tinggi: dashboard internal, alat power-user, atau onboarding. Pelajari pola sebelum mendorong ke produk inti.

4. Pikirkan strategi sovereign sejak awal. Bahkan jika Anda menggunakan API hyperscaler, pastikan arsitektur Anda dapat dipindahkan ke open-weight models dan infrastruktur on-prem bila kebijakan atau biaya berubah.

5. Investasi pada evaluasi yang dapat diskalakan. Semua paradigma di atas membuat evaluasi semakin sulit. Otomasi evaluasi, dataset benchmark domain-spesifik, dan budaya evaluasi adalah investasi paling tahan masa depan.

6. Kembangkan keterampilan lintas-disiplin. Engineer masa depan perlu memahami sistem terdistribusi, ML, UX, dan keamanan AI sekaligus. Pelatihan dan rotasi tim menjadi krusial.

7. Pantau perubahan model arsitektur. Bila Mamba atau arsitektur post-Transformer matang, banyak optimasi infrastruktur Anda perlu dirancang ulang. Jangan over-invest pada optimasi spesifik Transformer yang mungkin obsolete.

Kesimpulan

AI-Native bukan akhir perjalanan, melainkan satu titik dalam evolusi yang berkelanjutan. Delapan paradigma yang dibahas — Agentic, Compound AI, Physical AI, Generative UI, Self-Improving, Sovereign, AI-Native OS, dan Post-Transformer — masing-masing menggeser asumsi fundamental tentang bagaimana sistem cerdas dibangun.

Yang menarik bukan satu paradigma akan "menang", tetapi bagaimana mereka saling berinterseksi. Agen yang berjalan di OS AI-Native dengan model post-Transformer untuk konteks panjang, di-deploy secara berdaulat di edge, dengan UI generatif yang adaptif, sebagai sistem compound yang dapat memperbaiki dirinya sendiri — ini bukan satu produk, tetapi gambaran arah industri.

Bagi praktisi, pesan utamanya adalah: jangan terpaku pada definisi statis. Cloud-Native masih relevan. AI-Native masih matang. Tapi paradigma berikutnya sudah datang, dan organisasi yang membangun fleksibilitas arsitektural — bukan komitmen pada teknologi tertentu — akan paling siap menghadapi gelombang berikutnya.

Era AI tidak berhenti di model. Ia bergerak ke agen, ke dunia fisik, ke antarmuka yang hidup, ke sistem yang membangun dirinya sendiri. Tantangan dan peluangnya jauh lebih besar dari yang kita bayangkan dua tahun lalu, dan akan jauh lebih besar lagi dua tahun ke depan.